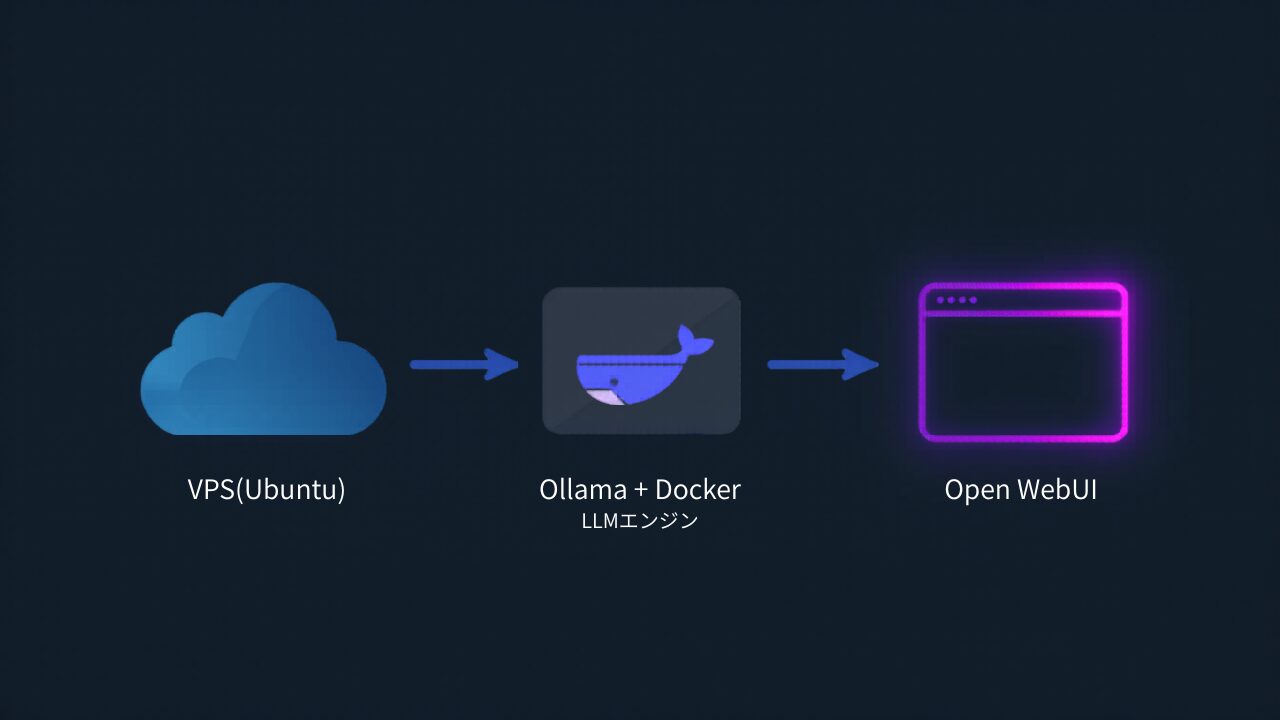

VPSにOllamaを入れれば、月額数千円でデータが外部に漏れない完全プライベートなAIサーバーを構築できます。ConoHa VPSの時間課金なら数十円からテスト可能で、Open WebUIを使えばChatGPTライクなUIで操作できます。

VPSにOllamaを入れれば、月額数千円で「自分だけのプライベートAIサーバー」が手に入ります。この記事では、VPSへのOllamaインストールから外部アクセス設定、Open WebUIの構築まで、つまずきやすいポイントを含めて完全解説します。

なぜローカルLLMをVPSで動かすのか?

ChatGPTやClaudeなどの商用APIは便利ですが、トークン課金のコストと機密データの外部送信リスクが常に付きまといます。VPS上でOllamaを動かせば、データが外部に一切漏れないクローズドなAI環境を構築でき、月額固定費のみで使い放題です。

自宅PCではVRAM不足で大規模モデルが動かない場合も、VPSならメモリ8GB以上のプランで7Bクラスのモデルを安定稼働でき、24時間どこからでもアクセス可能です。

CPU推論の限界を理解しよう

GPU非搭載のVPS(CPU推論)では、7Bモデルで1〜5 tokens/秒程度の生成速度です。リアルタイム対話には遅いため、用途に応じてGPUプランへの移行も検討しましょう。

| モデルサイズ | 必要メモリ | 推奨VPSプラン | 代表モデル |

|---|---|---|---|

| 3B以下 | 4GB | メモリ4GBプラン | Phi-3, Qwen 1.5B |

| 7B〜8B | 8GB以上 | メモリ8GBプラン | Llama 3 (8B), Mistral (7B) |

| 13B以上 | 16GB以上 | メモリ16GBプラン | Llama 3 (13B), CodeLlama |

VPS選び:ConoHa VPSがおすすめな理由

Ollama環境の構築に最適なのはConoHa VPSです。理由は2つあります。

「動かなかったらどうしよう」という不安を解消。初期費用無料+数円/時間の従量課金で、まずは8GBプランを数時間だけ立ち上げてテストできます。

CPU推論の速度に限界を感じたら、NVIDIA L4搭載のGPUサーバープランにプラットフォームを変えずに移行可能。将来の拡張性も万全です。

構築手順:OllamaインストールからOpen WebUIまで

ステップ1:VPSの初期設定

ConoHa VPSでUbuntu 22.04/24.04 LTS、メモリ8GB以上のプランを選択。SSH接続後、まずシステムを更新します。

sudo apt update && sudo apt upgrade -yステップ2:Ollamaのインストール

公式スクリプト1行でインストール完了です。

curl -fsSL https://ollama.com/install.sh | shsudo systemctl status ollamaで「active (running)」と表示されればOKです。

ステップ3:外部アクセスの設定(最重要)

Ollamaはデフォルトでlocalhost(127.0.0.1)のみでリッスンします。外部アクセスには環境変数の変更とファイアウォール設定が必要です。

# systemdのオーバーライドで環境変数を設定

sudo systemctl edit ollama

# エディタに以下を追記:

# [Service]

# Environment="OLLAMA_HOST=0.0.0.0"

# 設定を反映

sudo systemctl daemon-reload

sudo systemctl restart ollama# ファイアウォールでポートを開放

sudo ufw allow 22/tcp

sudo ufw allow 11434/tcp

sudo ufw enableセキュリティTips

特定IPのみ許可する場合は sudo ufw allow from [あなたのIP] to any port 11434 を使いましょう。

ステップ4:モデルのダウンロードと実行

ollama run llama3モデルの自動ダウンロード後、ターミナル上でチャットが開始されます。/byeで終了。

ステップ5:Open WebUI(ChatGPT風の画面)を導入

Dockerをインストールし、Open WebUIコンテナを起動します。

sudo apt install docker.io -y

docker run -d -p 3000:8080 \

--add-host=host.docker.internal:host-gateway \

-v open-webui:/app/backend/data \

--name open-webui --restart always \

ghcr.io/open-webui/open-webui:main–add-hostオプションの意味

Dockerコンテナ内のlocalhostはコンテナ自身を指すため、ホストOSのOllamaには直接到達できません。このフラグでホストへのルーティングパスを確立し、host.docker.internal:11434経由で通信可能にします。

ブラウザで http://[VPSのIP]:3000 にアクセスすれば、ChatGPTライクな画面でAIチャットを開始できます。

まとめ:自分だけのプライベートAIサーバーを構築しよう

VPS+Ollamaなら、データが外部に漏れない完全プライベートなAI環境を月額数千円で構築できます。ConoHa VPSの時間課金なら数十円からテスト可能です。

ConoHa VPSで自分だけのAIサーバーを構築する

![]()

※ 初期費用0円・最低利用期間なし・解約もWebで完結

コメント